Matemática para decifrar como funciona o aprendizado de máquina

Pesquisadores ocidentais desenvolveram uma nova técnica usando matemática para entender exatamente como as redes neurais tomam decisões – um processo amplamente reconhecido, mas pouco compreendido no campo do aprendizado de máquina.

Muitas das tecnologias atuais, desde assistentes digitais como Siri e ChatGPT até imagens médicas e carros autônomos, são alimentadas por aprendizado de máquina. No entanto, as redes neurais – modelos de computador inspirados no cérebro humano – por trás desses sistemas de aprendizado de máquina têm sido difíceis de entender, o que às vezes lhes valeu o apelido de “caixas pretas” entre os pesquisadores.

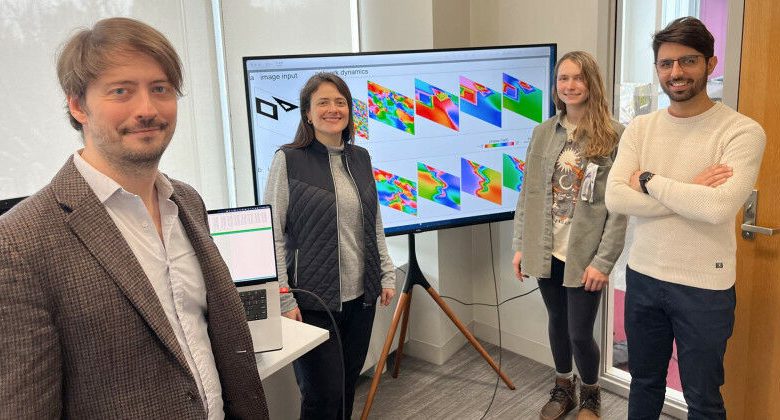

“Criamos redes neurais que podem executar tarefas específicas, ao mesmo tempo que nos permitem resolver as equações que governam a atividade das redes”, disse Lyle Muller, professor de matemática e diretor do Fields Lab for Network Science da Western, parte do recém-criado Fields- Centro de Colaboração Ocidental. “Essa solução matemática nos permite ‘abrir a caixa preta’ para entender precisamente como a rede faz o que faz.”

As descobertas foram publicadas na revista de alto impacto PNAS em colaboração com pesquisadores internacionais, incluindo o presidente de pesquisa de aprendizado de máquina da Universidade de Amsterdã, Max Welling.

Lyle Muller, professor de matemática e diretor do Fields Lab for Network Science da Western, parte do Fields-Western Collaboration Center. (Jeff Renaud/Comunicações Ocidentais)

'Ver coisas' segmentando imagens em partes

A equipe ocidental, que incluía Muller, os pós-doutorandos Luisa Liboni e Roberto Budzinski e o estudante de graduação Alex Busch, demonstrou pela primeira vez esse novo avanço em uma tarefa chamada segmentação de imagens – um processo fundamental em visão computacional onde sistemas de aprendizado de máquina dividem imagens em partes distintas. , como separar objetos em uma imagem do fundo.

Começando com formas geométricas simples, como quadrados e triângulos, eles criaram uma rede neural que poderia segmentar essas imagens básicas.

Muller e seus colaboradores usaram em seguida uma abordagem matemática, que desenvolveram anteriormente para estudar outras redes, para investigar como a nova rede executava essa tarefa de segmentação ao analisar essas imagens simples.

A abordagem matemática permitiu à equipe entender precisamente como ocorria cada etapa do cálculo. Surpreendentemente, a equipe descobriu que a rede também poderia segmentar – ou ver e interpretar – um punhado de imagens naturais, como fotografias de um urso polar caminhando na neve ou de um pássaro na natureza.

“Ao simplificar o processo para obter insights matemáticos, fomos capazes de construir uma rede que era mais flexível do que as abordagens anteriores e também teve um bom desempenho em novos dados que nunca tinha visto”, disse Muller, membro do Western Institute for Neuroscience.

“O que é particularmente emocionante é que isto é apenas o começo, pois acreditamos que esta compreensão matemática pode ser útil muito além deste primeiro exemplo.” – Lyle Muller, professor de matemática e diretor do Fields Lab for Network Science da Western

As implicações do trabalho vão além do processamento de imagens.

Em um estudo relacionado publicado em 2024, Muller e sua equipe desenvolveram uma rede “explicável” semelhante que poderia realizar várias tarefas, desde operações lógicas básicas até funções seguras de passagem de mensagens e memória.

Noutra colaboração com o professor de fisiologia e farmacologia Wataru Inoue e a sua equipa de investigação na Schulich School of Medicine & Dentistry, eles até ligaram com sucesso a sua rede a uma célula cerebral viva, criando um sistema híbrido que une redes neurais artificiais e biológicas.

“Este tipo de compreensão fundamental é crucial à medida que continuamos a desenvolver sistemas de IA mais sofisticados em que podemos confiar e nos quais podemos confiar”, disse Budzinski, pós-doutorado no Fields Lab for Network Science.