O dilema do uso da IA na UTI: vulnerável a desencadear medidas médicas errôneas

Escrevendo na conversa, Ali Akbar Septriandri (UCL Statistical Science) explica como podemos impedir o viés no uso da IA no mundo médico.

Pacientes que são tratados na sala da Unidade de Terapia Intensiva (UTI) são geralmente conectados a um tronco IV e a vários dispositivos médicos. O uso de dispositivos médicos, como monitores de sinais vitais, visa monitorar os sinais vitais do paciente, como freqüência cardíaca, pressão arterial e saturação (níveis de oxigênio no sangue).

Esses dispositivos médicos são ricos em dados úteis para apoiar o diagnóstico – o processo agora é muito auxiliado pela tecnologia de inteligência artificial (AI). Por exemplo, a tecnologia de IA pode ajudar a monitorar a condição dos pacientes pós-cardíacos, prever a progressão das condições dos pacientes com Covid-19, identificar sinais observáveis (fenótipos clínicos) de sepse e determinar a estratégia ideal de tratamento do paciente.

O problema é que os modelos All'ai (programas treinados para reconhecer padrões) são capazes de produzir a ajuda que os médicos precisam para diagnosticar os pacientes. Além disso, as fontes de dados que serão processadas pelos médicos são muito diversas, variando dos resultados das leituras de dispositivos médicos na UTI, análise de amostras de sangue no laboratório, ao histórico de saúde do paciente.

A diversidade de fontes de dados faz com que o processo de tomada de decisão médica se torne mais complexa. À medida que a complexidade dos casos manipulou aumenta, os resultados das leituras de IA estão se tornando cada vez mais transparentes.

Essa condição pode exacerbar o viés-caso você perceba ou não afeta as ações médicas que os médicos executam.

AI é vulnerável a exacerbar o viés contra medidas médicas

No mundo médico, alguns estudos destacam vários vieses que podem influenciar as decisões dos médicos. Um estudo de 2019, por exemplo, revelou que as pacientes do sexo feminino estavam mais em risco de experimentar uma redução ou descontinuação de terapia intensiva do que os homens. Essa tendência ocorre mesmo após outros fatores, como velhice e condição crítica do paciente, também são considerados.

Outro estudo descobriu que há desigualdade na assistência médica entre raças em preto e branco nos Estados Unidos (EUA). Essa desigualdade faz com que a taxa de mortalidade de pacientes negros na UTI seja maior que os brancos.

O viés no mundo da medicina supostamente piorará se os médicos confiarem apenas nos modelos de IA no diagnóstico de doenças, sem analisar os dados usando o motivo. Especialmente quando os modelos de IA aprendem padrões com dados tendenciosos devido a processos de amostragem abaixo do ideal e desigualdades sociais que limitam o acesso das pessoas às unidades de saúde.

Este fenômeno é como estudantes que fazem tarefas de faculdade usando Chatgptsem revisar criticamente os resultados.

Os modelos de IA prometem melhor precisão e personalização para ajudar no diagnóstico. No entanto, os resultados são processados a partir de dados grandes muito complexos; portanto, a análise humana ainda é necessária antes de tomar medidas.

Sem ceticismo sobre essa tecnologia, o impacto pode ser fatal.

Impedir o viés no uso de IA no mundo médico

Infelizmente, no campo, muitas vezes há um esforço para automatizar o processo de tomada de decisão para ações médicas com base na eficiência dos recursos de terapia intensiva.

Por exemplo, no caso da pandemia COVID-19, a pressão sobre o uso da UTI incentivou a automação de processos de tomada de decisão, como a alocação do leito de pacientes. Nesse tipo de situação precária, a possibilidade de tomar atalhos contando com os modelos de IA sem criticar o processo se torna maior. De fato, várias questões de acesso a serviços de saúde, como cobertura de seguro limitada, cronogramas de trabalho rígidos dos profissionais de saúde e a longa distância às unidades de saúde mais próximas supostamente exacerbar o viés no mundo da medicina.

Os modelos de IA que geralmente tomam decisões com base em vieses existentes aprenderão esses padrões como comuns e os interpretarão como um conhecimento importante no processo de tomada de decisão.

Portanto, são necessárias medidas preventivas para evitar viés devido à adoção de tecnologia médica baseada em IA, incluindo:

1. Educação da AI para profissionais de saúde

Os profissionais de saúde precisam ser educados sobre a IA para ter mais cuidado com o potencial e as limitações dessa tecnologia em rápido desenvolvimento.

As instituições de educação em saúde devem revisar o currículo e fazer da IA um dos assuntos. Esse método pode ajudar a mudar a mentalidade dos profissionais de saúde em relação ao uso da IA, que está se desenvolvendo muito massivamente.

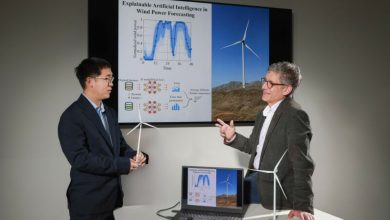

2. Dirigindo mais inovação clínica de IA

Os profissionais de saúde devem incentivar os desenvolvedores de IA a gerar modelos cuja análise de dados pode ser interpretada clinicamente, de maneira simples e transparente.

Os formuladores de políticas precisam exigir que os desenvolvedores de IA criem modelos transparentes antes que a tecnologia seja amplamente adotada.

3. Colaboração de pesquisa

Outra coisa crucial que geralmente é esquecida é a diversidade limitada dos dados da UTI disponíveis ao público. Uma revisão de 2022 revelou que os dados de UTI disponíveis em público e usados em muitos estudos foram provenientes de apenas quatro conjuntos de dados diferentes (conjuntos de dados), todos da Europa e dos Estados Unidos.

Portanto, a colaboração global de pesquisa é necessária para compartilhar dados da UTI. Como mencionado anteriormente, um modelo de dados tendenciosos perpetuará apenas esse viés. Como ilustração, os modelos de IA correm o risco de reduzir drasticamente seu desempenho quando usados em diferentes hospitais em um país. Nesse caso, o uso de dados locais de outros países é urgentemente necessário para reduzir a gravidade de tais vieses.

A comunidade médica do país pode se adaptar à comunidade linguística computacional que rotineiramente mantém Recursos e Avaliação de Linguagem (LREC) Conferências a cada dois anos. Este fórum pretende publicar dados e resultados de pesquisas de várias regiões do mundo.

Enquanto isso, a comunidade médica global precisa realizar conferências e criar periódicos focados na comunicação de dados médicos e pesquisas de países que são menos conhecidos no mundo acadêmico global.

4. Regulação do uso de IA

Não basta parar por aí, o governo precisa implementar regulamentos sobre a ética do uso da IA no mundo médico. A OMS e a União Europeia, por exemplo, formularam regulamentos para garantir e avaliar o desempenho, a segurança e a precisão dos modelos de IA no setor de saúde, para que sejam fáceis de usar, livres de preconceito e discriminação.

Garantir a terapia intensiva sem preconceitos requer um esforço abrangente envolvendo uma gama diversificada de partes interessadas, incluindo médicos, profissionais de saúde, acadêmicos, desenvolvedores de tecnologia e governos.

É necessário um compromisso de todas as partes interessadas para iniciar essa colaboração. Esta etapa pode começar com a compreensão, reconhecimento e avaliação da existência de viés invisível nos serviços de saúde.

Este artigo foi publicado originalmente em A conversa em 26 de janeiro de 2025.

- University College London, Gower Street, Londres, WC1E 6BT (0) 20 7679 2000